在Hassan Ugail教授的带领下,研究人员开始使用两个预先存在的数据集 - 其中一个(称为MUG)由真实和自发地微笑的人的视频组成,而另一个(称为CK +)包含人们假笑的视频。

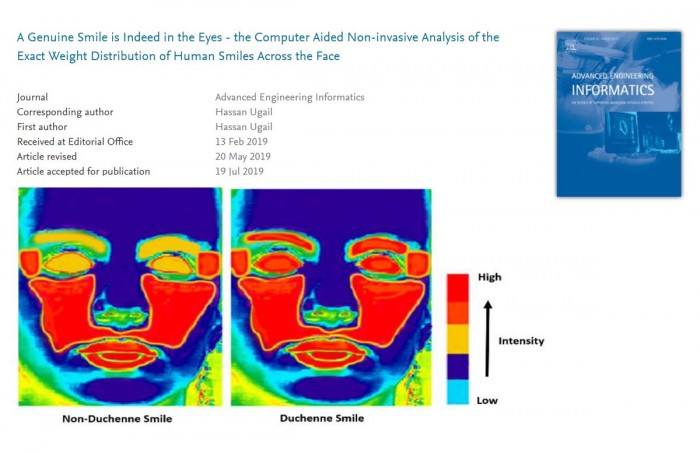

基于人工智能的算法用于映射这些视频中个体的面部,测量他们的嘴,脸颊和眼睛在微笑时移动的顺序和程度。虽然这三个领域的两组之间存在差异,但最大的一组涉及眼睛。真正微笑的人其眼睛周围的肌肉移动至少比假笑者多10%。

从该评估中吸取了教训,由此产生的软件现在能够评估微笑的人的视频,准确地判断他们的笑容是否真实。科学家希望该技术最终可用于诸如改进的生物识别安全系统,更好的人/计算机接口和心理学研究等应用。

“当我们微笑时,我们使用两组主要的肌肉 - 颧骨主要部分,它负责嘴角上扬,以及眼轮匝肌,这会导致眼睛周围的皱纹,”Ugail说道。“在假笑中,通常只有嘴部肌肉移动,但是,作为人类,我们通常不会发现眼睛周围缺乏运动。计算机软件可以更加可靠地发现它。”

该研究在最近发表于《Advanced Engineering Informatics》期刊上的论文中有所描述。